いつも読んでいただき、ありがとうございます。

最近話題になっているローカルLLM。

「MacBook Airでも実用的に動くのか?」気になっている方も多いと思います。

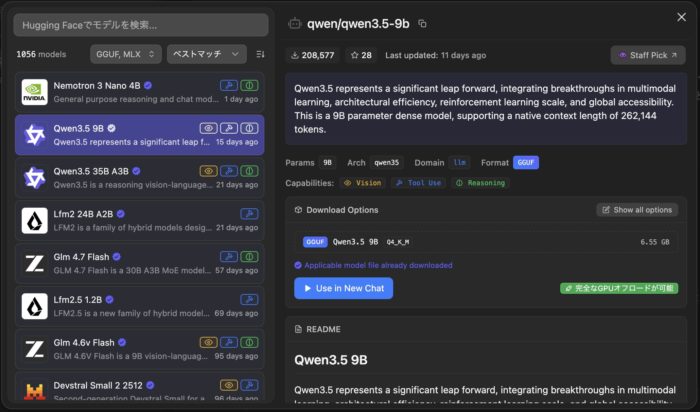

今回は、15インチMacBook Air M5(メモリ24GBモデル)で実際にLM Studioを使ってローカルLLMを動かしてみたので、その結果をまとめます。

試したモデル

今回試したのは以下の2つです。

- Qwen3.5 9Bモデル(今話題の軽量高性能モデル)

- GPT-OSS 20B

結論:24GBあれば十分実用レベル

まず結論から。

MacBook Air M5(24GB)でローカルLLMは問題なく動作可能

特に以下のモデルは快適に動きました。

- Qwen3.5 9B

- GPT-OSS 20B

一方で、それ以上の大規模モデル(30Bとか)になるとメモリ不足で使い物にならないです。

実際の生成速度はどれくらい?

Qwen3.5 9Bでの生成速度は、

約17トークン/秒(デフォルト設定のまま)

一般的に、

- 20トークン/秒前後 → 快適

- 15トークン/秒以上 → 実用レベル

と言われているので、

17トークン/秒なら十分実用的

体感としてもストレスなく使える速度でした。

発熱や動作の安定性

ローカルLLMを動かすとさすがに発熱はありますが、

- 動作は安定

- 今のところ極端な熱暴走などはなし

という印象です。

Appleシリコンの特徴でもある

- ユニファイドメモリ

- GPUのAI性能の高さ

このあたりがしっかり効いていると感じました。

どこまでのモデルが限界か?

まだたくさん試しているわけではないのですが、MacBook Air M5(24GB)で現実的に使えるラインは以下です。

快適に使える

- Qwen3.5 9B

- GPT-OSS 20B

厳しくなる領域

- それ以上の大規模モデル(30B以上など)

大きなモデルになると、どうしてもネックになるのがメモリです。

- 48GB

- 64GB

- 128GB

といった、Pro や Maxモデルで搭載できるメモリ容量が必要になります。

MacBook Air vs Proの選び方

MacBook AirでOKな人

- 軽量なローカルLLMを試したい

- Qwenクラスで十分

- 普段使い+AIちょい使い

24GB or 最大32GBで十分

MacBook Proを選ぶべき人

- 大規模モデルを動かしたい

- 研究用途・本格開発

- 長時間の高負荷処理

できれば48-64GB以上のメモリが欲しい

まとめ

今回の検証結果をまとめると

- MacBook Air M5(24GB)でローカルLLMは問題なく動く

- Qwen3.5 9Bは快適に使える

- 生成速度は約17トークン/秒で実用十分

- 大規模モデルはメモリ不足で厳しい

最終結論

Qwen3.5 9Bを使うなら、MacBook Air M5(24GB)で全く問題なし

ローカルLLM入門としては、かなりバランスの良い構成だと思います。

ただし本格的にローカルLLMを動かしたいという人は、大容量メモリを積むことのできるM5 Pro or Max の検討が必要となります。

コメント